Les belles promesses du Deep Learning

Il existe de nombreux satellites d’observation de la terre, et chacun d’eux possède ses avantages et ses inconvénients. Par exemple, la constellation Sentinel-2 permet d’acquérir en moyenne une image tous les cinq jours à 10 m de résolution partout sur le globe, tandis que les satellites à très haute résolution spatiale comme Spot-6 et Spot-7 sont capables de fournir des images à 1,5 m de résolution, mais avec une fréquence d’acquisition moins importante et sur des surfaces plus réduites.

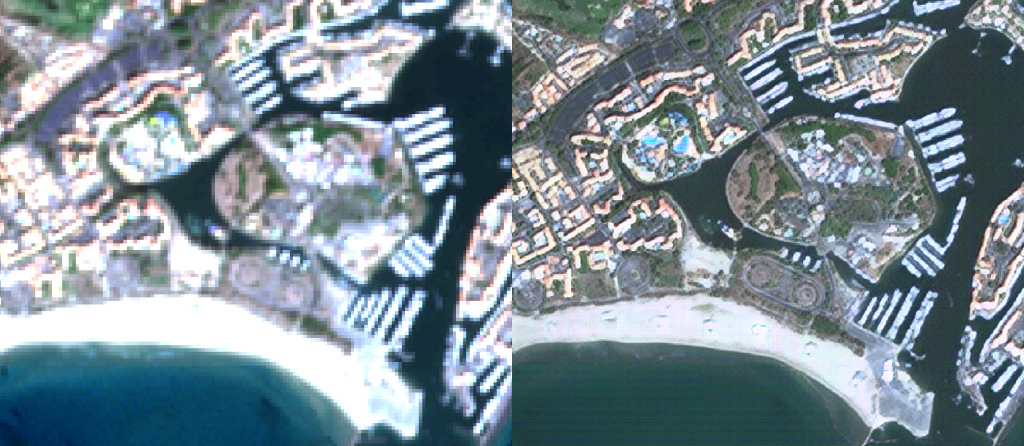

Et si il était possible de fusionner ces différentes sources d’imagerie de sorte à obtenir une sorte de « super capteur » qui bénéficierait à la fois de la fréquence d’acquisition de Sentinel à une résolution aussi fine que celle de Spot 6/7 ? Aujourd’hui, les dernières techniques de deep learning obtiennent des des résultats, qu’il serait dommage de ne pas considérer.

Une super-résolution par imitation

Le groupe MDL4EO de l’UMR TETIS utilise des méthodes fondées sur le deep learning pour faire, entre autres, de la super-résolution d’images Sentinel-2. Les images Sentinel-2 sont traitées avec un réseau de neurones artificiels profonds pour passer d’une résolution à 10 m à une résolution à 1,5 m. Pour entraîner ce réseau de neurones à effectuer ce travail, on utilise à la fois d’images Spot 6/7 acquises dans le cadre de l’Equipex Geosud et des images composites mensuelles Sentinel-2 provenant de Theia grâce aux méthodes et outils développés au Cesbio et au CNES (les images sont calibrées en réflectance et dénuagées, facilitant grandement le processus). Les images sont acquises à la même date, à deux semaines d’intervalle près. Seules les bandes à 10 m (Rouge, Vert, Bleu et Proche infrarouge) de Sentinel-2 sont utilisées en raison de leur proximité spectrale avec les canaux des images Spot-6/7.

On apprend au réseau de neurones à « imiter » une image haute résolution Spot 6/7 à partir des images Sentinel-2, en utilisant une technique appelée Generative Adversarial Networks. Cette technique met en œuvre deux réseaux de neurones : le générateur et le discriminateur. Le générateur cherche à tromper le discriminateur, en fabriquant, à partir des images basse résolution, des images à très haute résolution aussi vraies que les originales, tandis que le discriminateur cherche à détecter les images fabriquées par le générateur. Cette compétition s’achève lorsque les deux « joueurs » ont prouvé combien ils étaient doués : le générateur fabrique des images trompant autant que possible le discriminateur, et le discriminateur arrive à détecter au mieux les images créées par ce dernier. De cette façon, on utilise le générateur pour transformer des images Sentinel-2 à 10 m de résolution en images très haute résolution à 1,5 m de résolution.

OrfeoToolBox : l’outil adapté

La librairie Orfeo ToolBox3 avec son extension OTBTF4 permet les pré-traitements des images, l’extraction de données d’apprentissage, l’entraînement des réseaux, et la génération d’images Sentinel-2 à quatre canaux (bandes rouge, vert, bleu et proche infrarouge) super-résolues à 1,5 m d’une taille de 72 000 par 720 00 pixels, en deux heures par scène environ.

Plus de détails sur la méthode utilisée, ainsi que les résultats obtenus sont consultables en ligne5. Les images obtenues peuvent y être visualisées en pleine résolution. Cette technique, qui semble prometteuse à des fins illustratives notamment, permet d’obtenir des images ressemblant à s’y méprendre à de « vraies » images. Cependant, il ne faut pas oublier que les algorithmes ne peuvent pas « inventer » des informations qui ne se trouvent pas dans les données originales, dans notre cas, dans des images Sentinel-2 avec une résolution spatiale de 10 m !

Contact

Rémi Cresson

INRAE | Tetis

@R.Cresson

Contributions